Alucinações de IA são quando inteligências artificiais produzem informações que parecem verdadeiras, mas são incorretas, decorrendo de dados de treinamento deficientes ou interpretação contextual falha, impactando decisões em setores como saúde e finanças.

Você já se deparou com uma informação absurda gerada por uma IA? Alucinação de IA’s é real e pode confundir muita gente. Vamos explorar isso juntos e descobrir como lidar.

Fonte: https://www.youtube.com/watch?v=sV_ZZufEdxk

Entendendo a alucinação de ia

As alucinações de IA ocorrem quando um sistema de inteligência artificial gera informações que parecem confiáveis, mas são de fato falsas ou enganosas. Isso pode surgir devido a problemas nos dados de treinamento ou limitações no entendimento contextual. Com a popularização das IAs em diversas plataformas, é importante entender como e por que essas alucinações acontecem.

Fonte: The Conversation

As alucinações são especialmente comuns em modelos de linguagem que, em vez de buscar precisão, podem gerar conteúdo plausível baseado em padrões aprendidos. Essa falha destaca a necessidade de supervisão humana e ajuste contínuo dos sistemas para minimizar erros.

Erros de IA podem resultar em desinformação, decisões automatizadas incorretas e perda de confiança em tecnologias avançadas. Assim, compreender esse fenômeno auxilia na criação de estratégias para mitigar riscos, garantindo uma aplicação mais segura e eficiente da IA.

impactos das informações incorretas no cotidiano

Informações incorretas originadas de sistemas de inteligência artificial têm o potencial de afetar diversas áreas do nosso cotidiano. Em plataformas de redes sociais, por exemplo, algoritmos podem destacar conteúdos enganadores, influenciando opiniões e decisões de forma inadvertida. No campo da saúde, diagnósticos errôneos por IA podem levar a tratamentos inadequados, comprometendo a segurança do paciente.

No setor financeiro, um pequeno erro gerado por um algoritmo pode resultar em decisões econômicas desastrosas, afetando desde investimentos pessoais até o mercado internacional. Sistemas de IA que não são constantemente atualizados e verificados podem introduzir viés, levando a análises incorretas.

Este cenário destaca a necessidade de desenvolver soluções tecnológicas mais precisas e supervisionadas, garantindo que informações erradas não comprometam a integridade de serviços essenciais e a confiança do público.

Corrigindo alucinações: soluções práticas

Corrigir alucinações de inteligência artificial requer a implementação de múltiplas estratégias para garantir que os sistemas não produzam informações enganosas. Uma abordagem fundamental é o uso de dados de treinamento de alta qualidade, abrangentes e diversificados, que permitem que a IA aprenda padrões reais e significativos. A revisão manual por especialistas humanos também é essencial para identificar e corrigir erros de interpretação feitos pela IA.

Implementar mecanismos de verificação automática de informações pode ajudar a mitigar o impacto de erros. Isso pode incluir a comparação cruzada de informações geradas com fontes confiáveis e bancos de dados verificados. Além disso, um sistema de feedback contínuo que permita ajustes em tempo real é crucial para manter a precisão.

O desenvolvimento de algoritmos mais transparentes e auditáveis também é vital para garantir que as decisões da IA possam ser compreendidas, corrigidas e confiadas. Estas soluções práticas não apenas reduzem alucinações, mas também aumentam a confiança na tecnologia.

Erro em Assistentes Virtuais

Assistentes de voz já confundiram comandos, resultando em ações inesperadas, desde compras inadvertidas até controles de dispositivos. Tais erros evidenciam a necessidade de tornar as IAs mais robustas e adaptativas frente a situações imprevistas.

Cada um desses casos sublinha a necessidade contínua de aperfeiçoar os dados de treinamento e a modelagem dos sistemas de inteligência artificial, assegurando que os erros que afetam vidas e negócios sejam minimizados.

#datafabri

81% das empresas que já utilizam IA generativa afirmam ter preocupado com alucinações e informações imprecisas na comunicação com clientes, impactando confiança e tomada de decisão.

fonte: Gartner

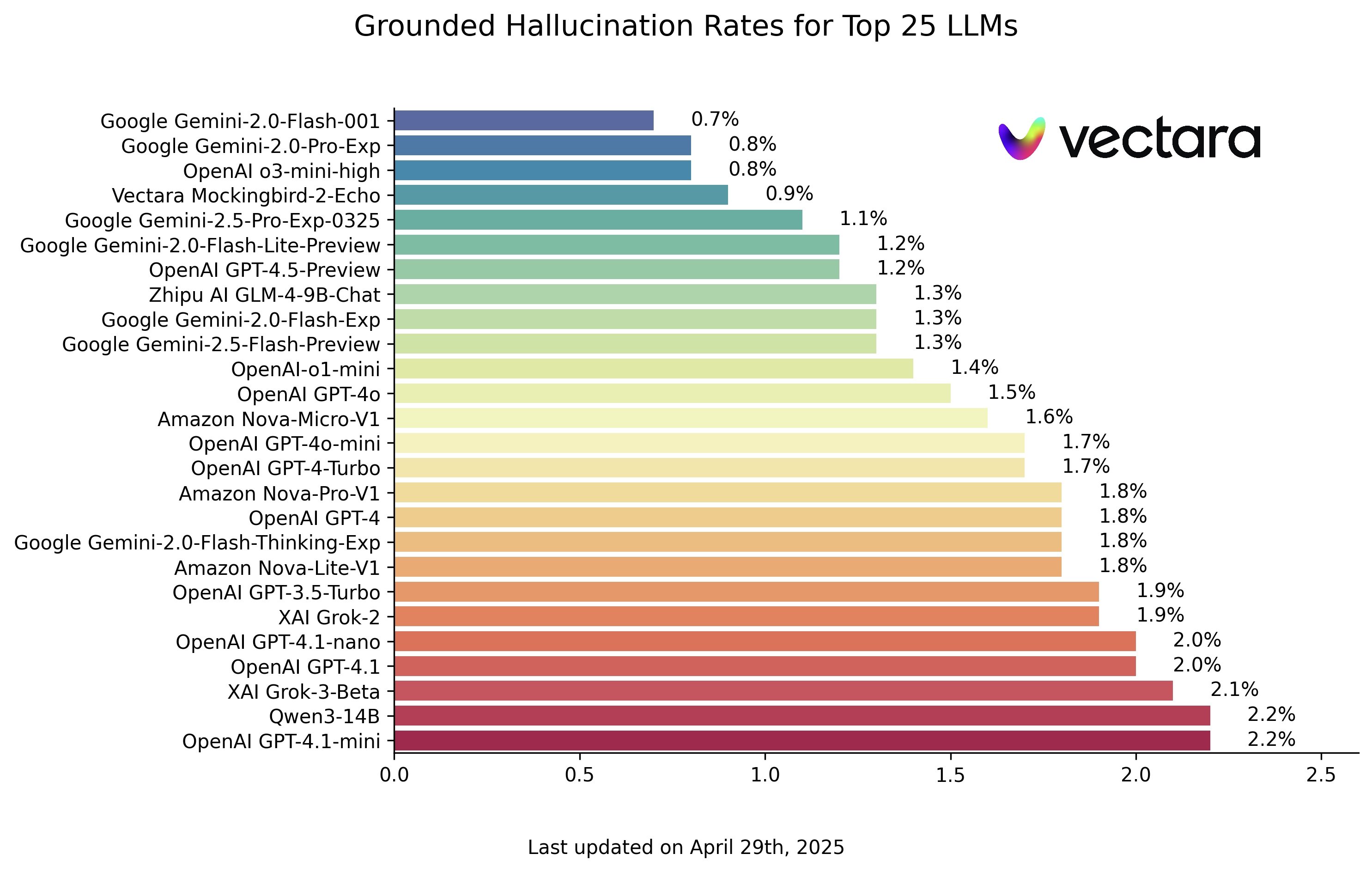

um estudo da Stanford + UC Berkeley analisou o GPT ao longo do tempo e identificou quedas de precisão de até 17% em tarefas de lógica e dados, mostrando variação e instabilidade na geração de respostas.

fonte: Stanford Center for Research on Foundation Models

44% dos líderes de TI afirmam que alucinações de IA já causaram riscos reais em projetos internos, como decisões erradas ou mensagens incorretas para clientes.

fonte: McKinsey State of AI Report 2023

47% dos usuários dizem que desconfiam de respostas geradas por IA caso não haja fontes verificáveis anexadas, reforçando a necessidade de citar dados e incluir referências.

fonte: Pew Research Center

soluções baseadas em RAG (Retrieval-Augmented Generation) reduzem alucinações em até 60%, pois a IA passa a gerar respostas somente a partir de bases verificadas, e não do que “imagina”.

fonte: Meta AI Research, 2022

Como podemos enfrentar o desafio das alucinações de IA?

A inteligência artificial está transformando diversos setores, mas também traz desafios significativos, como as alucinações. Para minimizar esses erros, é essencial investir em dados de qualidade, revisões humanas e algoritmos transparentes. Estratégias práticas, como ferramentas de verificação e feedback contínuo, ajudam a assegurar a precisão das informações geradas.

Além disso, casos famosos de erros de IA servem como lembretes importantes sobre a necessidade de aperfeiçoar incessantemente essas tecnologias. Apesar das dificuldades, as estatísticas mostram que a IA continuará a impactar a economia global e a automação de processos, tornando-se uma parte central do nosso cotidiano.

Portanto, enfrentar essas alucinações de IA é não apenas um desafio técnico, mas também uma oportunidade para avançar e otimizar o uso dessas ferramentas incríveis.

FAQ – Perguntas frequentes sobre alucinações de IA e informações incorretas

o que são alucinações de ia?

alucinações de ia acontecem quando um modelo gera informações aparentemente coerentes, porém incorretas, inventadas ou sem base real nos dados utilizados.

por que as alucinações de ia são um problema?

elas podem causar desinformação, gerar decisões equivocadas e reduzir a confiança em sistemas automatizados, especialmente quando utilizadas em contextos críticos.

como podemos corrigir erros de ia?

usar dados de treinamento mais precisos, implementar revisão humana contínua e aplicar ferramentas automáticas de checagem e validação ajudam a reduzir erros.

existem casos famosos de erros de ia?

sim. exemplos incluem falhas em sistemas de reconhecimento facial que demonstraram vieses raciais e erros em assistentes virtuais que interpretam comandos de forma incorreta.

qual é o impacto econômico da ia no mundo?

projeções indicam que a ia pode aumentar o pib mundial em até 14% até 2030, representando cerca de 15 trilhões de dólares adicionados à economia global.

quais setores são mais afetados pelas alucinações de ia?

tecnologia, finanças e saúde são os mais impactados, pois dependem de decisões precisas baseadas em análises realizadas por sistemas inteligentes.